Beam Cloud

Beam Cloud aide les équipes à exécuter des fonctions Python, tâches GPU et workloads IA dans le cloud avec une approche serverless développeur, avec un positionnement clair pour les workflows IA professionnels.

La solution répond à un enjeu fréquent des équipes IA : transformer des expérimentations isolées en workflows plus fiables, mesurables et documentés.

Son intérêt principal repose sur la capacité à améliorer la qualité d’exécution, la gouvernance des données, la productivité ou la mise en production selon le contexte.

Beam Cloud peut être utilisé par des profils produit, data, engineering, growth, support ou opérations lorsque l’organisation veut mieux industrialiser ses usages IA.

L’outil s’intègre généralement dans une stack existante via API, SDK, connecteurs, notebooks, environnements cloud ou services de données.

La valeur ne dépend pas uniquement des fonctionnalités, mais aussi de la qualité des données, de la définition du workflow et des critères d’évaluation utilisés.

Une adoption progressive reste recommandée : commencer par un scénario limité, mesurer les résultats, puis étendre l’usage si le gain est confirmé.

Dans ListoolAI, Beam Cloud se positionne comme une solution pertinente pour enrichir la catégorie Infrastructure IA avec une fiche claire, SEO-first et exploitable.

Comment utiliser Beam Cloud ?

- Définir le besoin : identifier précisément le workflow, la donnée ou le problème que Beam Cloud doit améliorer.

- Préparer les accès : rassembler les sources, clés API, environnements, jeux de test ou dépôts nécessaires au premier essai.

- Configurer un pilote : mettre en place un scénario court afin de limiter les risques et de mieux comparer les résultats.

- Mesurer les résultats : observer la qualité, le temps gagné, les coûts, les erreurs et les retours utilisateurs sur le pilote.

- Déployer progressivement : documenter les paramètres retenus, ajouter des contrôles et étendre l’usage uniquement si la valeur est confirmée.

Analyse détaillée

Beam Cloud présente un intérêt solide pour les organisations qui veulent professionnaliser leurs usages IA. Son adoption doit être validée sur un cas d’usage réel, avec des critères de qualité, de coût, de sécurité et de maintenabilité clairement définis.

Fonctionnalités & Cas d’usage

- Serverless Python : fonctionnalité utile pour structurer, accélérer ou fiabiliser un workflow IA avec Beam Cloud.

- GPU cloud : fonctionnalité utile pour structurer, accélérer ou fiabiliser un workflow IA avec Beam Cloud.

- Fonctions déployables : fonctionnalité utile pour structurer, accélérer ou fiabiliser un workflow IA avec Beam Cloud.

- Jobs asynchrones : fonctionnalité utile pour structurer, accélérer ou fiabiliser un workflow IA avec Beam Cloud.

- Volumes persistants : fonctionnalité utile pour structurer, accélérer ou fiabiliser un workflow IA avec Beam Cloud.

- Images personnalisées : fonctionnalité utile pour structurer, accélérer ou fiabiliser un workflow IA avec Beam Cloud.

- APIs rapides : fonctionnalité utile pour structurer, accélérer ou fiabiliser un workflow IA avec Beam Cloud.

- Scaling automatique : fonctionnalité utile pour structurer, accélérer ou fiabiliser un workflow IA avec Beam Cloud.

- Inference IA : cas d’usage concret où Beam Cloud peut apporter un gain de qualité, de contrôle ou de productivité.

- Traitement batch : cas d’usage concret où Beam Cloud peut apporter un gain de qualité, de contrôle ou de productivité.

- Fonctions GPU : cas d’usage concret où Beam Cloud peut apporter un gain de qualité, de contrôle ou de productivité.

- Prototypes ML : cas d’usage concret où Beam Cloud peut apporter un gain de qualité, de contrôle ou de productivité.

- Automatisation Python : cas d’usage concret où Beam Cloud peut apporter un gain de qualité, de contrôle ou de productivité.

- Déploiement rapide : cas d’usage concret où Beam Cloud peut apporter un gain de qualité, de contrôle ou de productivité.

Intégrations

- Python

- Docker

- Hugging Face

- PyTorch

- FastAPI

- Cloud storage

- APIs

Ces intégrations permettent à Beam Cloud de s’insérer progressivement dans des workflows existants sans imposer une architecture unique.

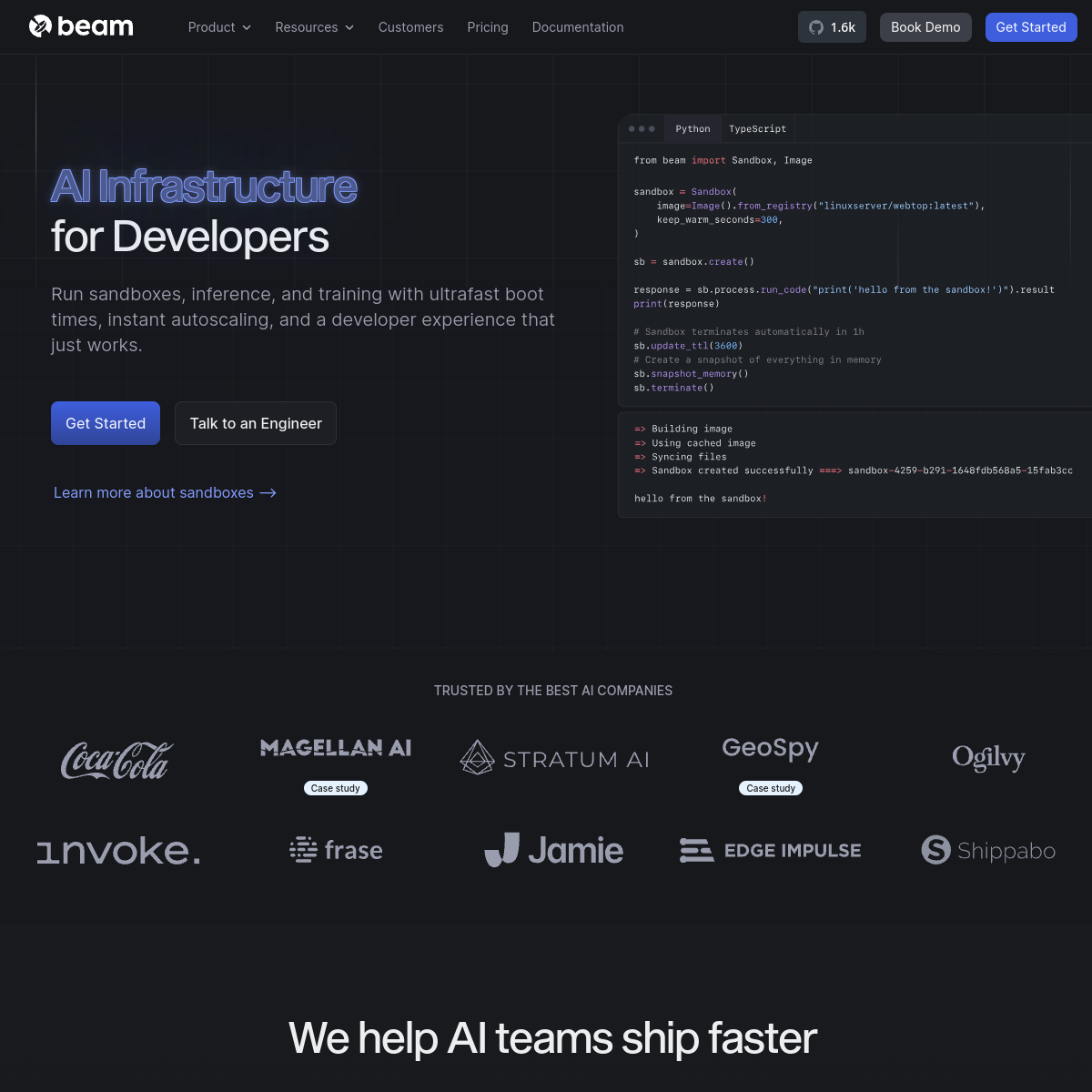

Screenshots

Tarification

- Free / Starter – démarrage pour fonctions et workloads limités selon quotas publics

- Pay As You Go – facturation selon ressources, temps d’exécution et GPU utilisés

- Enterprise – support, limites et sécurité sur demande

Avantages & Limites

👍 Avantages

- Positionnement clair pour un usage professionnel ou technique.

- Peut s’intégrer dans une stack existante sans refonte complète.

- Utile pour rendre les workflows IA plus fiables, mesurables ou productifs.

- Pertinent pour tester une brique spécialisée avant industrialisation.

👎 Limites

- La valeur dépend fortement de la qualité du cas d’usage et des données disponibles.

- Les scénarios avancés peuvent demander des compétences techniques.

- Les limites, connecteurs ou offres peuvent évoluer selon la roadmap officielle.

FAQ

À quoi sert Beam Cloud ?▶

Beam Cloud sert à exécuter des fonctions Python, tâches GPU et workloads IA dans le cloud avec une approche serverless développeur dans un contexte professionnel ou technique.

Beam Cloud convient-il aux équipes ?▶

Oui, l’outil peut être pertinent pour les équipes qui veulent structurer, contrôler ou industrialiser leurs usages IA.

Faut-il savoir coder pour utiliser Beam Cloud ?▶

Cela dépend du cas d’usage. Les usages avancés nécessitent souvent une base technique, surtout pour les APIs, SDK ou pipelines.

Beam Cloud peut-il s’intégrer à une stack existante ?▶

Oui, l’outil est généralement conçu pour s’insérer progressivement dans des environnements data, produit ou engineering déjà en place.

Beam Cloud remplace-t-il les outils métier existants ?▶

Non, il agit plutôt comme une brique spécialisée qui complète un workflow ou une architecture IA existante.

Comment évaluer Beam Cloud ?▶

Il est conseillé de tester un scénario limité, de mesurer la qualité obtenue, puis de décider si l’outil mérite une intégration plus large.

Alternatives

- Modal

- Cerebrium

- RunPod

- AWS Lambda

Avis sur Beam Cloud

🔍 Outils similaires

Cerebrium

Cerebrium aide les équipes à déployer des workloads IA serverless, modèles GPU et applications temps réel sans gérer l’infrastructure lou…

Stack AI

Stack AI aide les équipes à construire des agents et workflows IA no-code connectés aux données et applications métier, avec une approche…

Khoj

Khoj aide les équipes à proposer un assistant personnel open source capable de rechercher dans notes, documents et sources connectées, av…

Vespa

Vespa aide les équipes à déployer des systèmes de recherche, recommandation et RAG à grande échelle avec ranking hybride, avec une approc…

ZenML

ZenML aide les équipes à orchestrer des pipelines ML et GenAI reproductibles, du notebook au déploiement en production, avec un positionn…

Fiddler AI

Fiddler AI aide les équipes à surveiller, expliquer et gouverner les modèles IA en production, y compris les systèmes GenAI et ML traditi…